Il signor 0/1, ovvero come Claude Shannon insegnò al mondo a parlare per cifre

[ACCADDE OGGI]

A 110 anni dalla nascita di uno dei padri dell’intelligenza artificiale: aneddoti, scoperte e quel curioso filo che lega il monociclo dei Bell Labs al chatbot di Anthropic

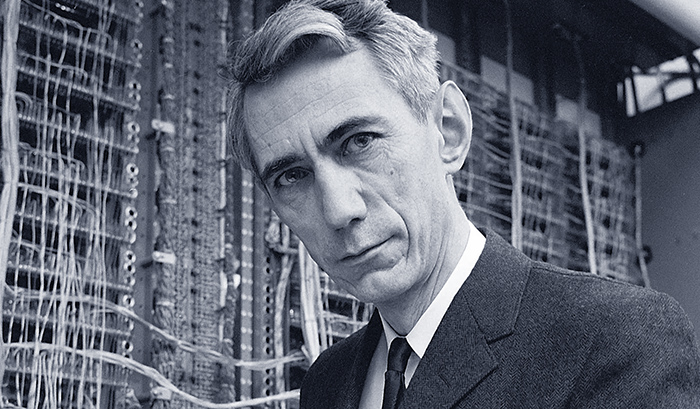

L’intelligenza artificiale, come tutte le rivoluzioni, ha più padri di quanti se ne ricordino. Per stanarne uno dei più nascosti, forse conviene partire da una curiosità minima: perché il chatbot di Anthropic si chiama Claude? La spiegazione fornita dalla società guidata da Dario Amodei è doppia: Claude è anzitutto un tributo a Claude Shannon, padre della teoria dell’informazione; e poi, più prosaicamente, un nome che suona caldo e privo, a differenza di ChatGPT, di evocazioni da elettrodomestico. Sotto la mascotte con la macchia rossa che ne è l’emblema, dunque, vibra uno spettro: quello del matematico che, ottant’anni fa, insegnò alle macchine a parlare per cifre.

Era nato il 30 aprile 1916 a Petoskey, una cittadina del Michigan. Studiò all’Università del Michigan, conseguì il master e il dottorato al Massachusetts Institute of Technology e, nei corridoi dei Bell Telephone Laboratories, di sera, pedalava in monociclo. «Lavorava per lo più con la porta chiusa», raccontò il collega David Slepian sulle pagine del New York Times, «ma se entravi era pazientissimo. Era l’unica persona a cui applicherei quella parola: genio».

A vent’anni Shannon scrisse quella che lo storico Herman Goldstine ha definito una delle tesi di master più importanti mai scritte. L’idea era limpida come una formula: l’algebra che il britannico George Boole aveva chiamato pomposamente “le leggi del pensiero”, fatta di soli “vero” e “falso”, poteva essere realizzata fisicamente con interruttori elettrici. Acceso uguale 1, spento uguale 0. Una notte, la progettazione dei circuiti smise di essere arte e diventò scienza. Il vero colpo di genio, però, arrivò dodici anni più tardi, in un articolo del 1948 dal titolo molto sobrio: Una teoria matematica della comunicazione. Lì Shannon propose una mossa che oggi sembra ovvia e allora apparve aliena. Ogni messaggio, come una lettera d’amore, una sinfonia di Beethoven, un film di Kurosawa, andava considerato per quantità, non per contenuto. La sua misura minima si chiamava bit, contrazione di binary digit; il termine, suggerito dal collega John Tukey, comparve per la prima volta in stampa proprio in quel saggio.

Italo Calvino, nelle Lezioni americane, scelse il termine “leggerezza” come prima parola per il millennio che si apriva. Lo scrittore non lo dice, ma quella parola ha un padre tecnico, ed è proprio Shannon: ridurre l’informazione – cosa diversa dal segnale – a un fluido che scorre dentro tubi di varia capacità, indifferente al fatto di trasportare un sonetto o un trailer di film. James Gleick, autore di The Information, lo riassume sul New Yorker con una franchezza memorabile: paragonarlo a Einstein sarebbe banale, eppure oggi viviamo nell’era dell’informazione, e le impronte di Shannon stanno su ogni schermo che fissiamo.

Da quella teoria discendono due limiti che oggi reggono la rete del pianeta. L’entropia (H) è il numero minimo di bit che servono per dire ciò che si vuole dire. La capacità (C) è il massimo che un canale, anche disturbato dal rumore, può portare senza errori. La regola d’oro è semplice: se H è inferiore a C, la comunicazione passa indenne. È la ragione per cui dal Wi-Fi alla sonda Voyager i nostri segnali continuano ad arrivare a destinazione.

Statua di Claude Shannon – AT&T Shannon Labs

Dietro la formula c’era un uomo allergico alla solennità. La sua casa di Winchester, Massachusetts, lui la chiamava Entropy House, e vi accumulava oggetti irresistibili e curiosi: una tromba lanciafiamme, un frisbee a razzo, un calcolatore a numeri romani battezzato THROBAC, un garage con almeno trenta monocicli (uno con la ruota quadrata, uno per due passeggeri). Ispirato dal pioniere dell’intelligenza artificiale Marvin Minsky, costruì la cosiddetta Ultimate Machine (oggi nota su YouTube come “macchina inutile”) che funziona così: si accende l’interruttore, esce una mano meccanica, l’interruttore viene rispento, la mano si ritira nella scatola. «Hackerava il reale», sintetizzò la filosofa digitale Amber Case sul New Yorker.

Volendo cercare un’origine al chatbot che oggi porta il suo nome, è sufficiente seguirne i passi. Nell’estate del 1941 Shannon comincia a lavorare ai Bell Labs, dove incrocia Alan Turing (già crittoanalista per il governo inglese) e con lui parla di intelligenza artificiale prima ancora che la disciplina abbia un nome. Più tardi costruirà Theseus, un mouse meccanico che impara a uscire da un labirinto, e un automa giocatore di scacchi. Gli scacchi, del resto, restavano una delle sue passioni: nel 1950, in Programming a Computer for Playing Chess, Shannon stimò che le partite possibili in una sfida di quaranta mosse fossero dell’ordine di 10^120, il cosiddetto “numero di Shannon”, e dimostrò che, contro un albero combinatorio così smisurato, la forza bruta era impraticabile. Era una premessa, non una resa: programmando l’euristica al posto dell’enumerazione, sosteneva che una macchina poteva imparare a giocare. Da quell’intuizione discende una buona parte dell’IA contemporanea, dagli engine scacchistici fino agli odierni algoritmi di ricerca. Marvin Minsky ricordò sul New York Times che a Shannon non sfuggivano problemi: qualunque cosa gli si presentasse, la affrontava con gioia, fosse un nuovo concetto tecnico oppure un martello e una sega.

Si ritirò relativamente presto dalla scena: dal 1960 in poi pubblicò pochissimo. Negli ultimi anni l’Alzheimer prese a velargli i pensieri. Morì nel 2001, ottantaquattrenne, in una casa di cura del Massachusetts. Robert Gallager, ingegnere elettrico al MIT, ne sintetizzò sul Times la lezione in una sola riga: era stato Shannon a intuire che la cifra binaria fosse l’elemento fondamentale di ogni comunicazione. Da quel piccolo seme, un sì o un no, una luce accesa o spenta, è germogliato l’albero che, dopo decenni e miliardi di transistor, oggi mette qualche frutto e si fa chiamare Claude. Una linea sottilissima e tenace, una “leggerezza con pensiero” lunga settant’anni, tiene insieme il monociclo nei corridoi del 1942 e i modelli linguistici del 2026.

Sebastiano Catte, com.unica 30 aprile 2026